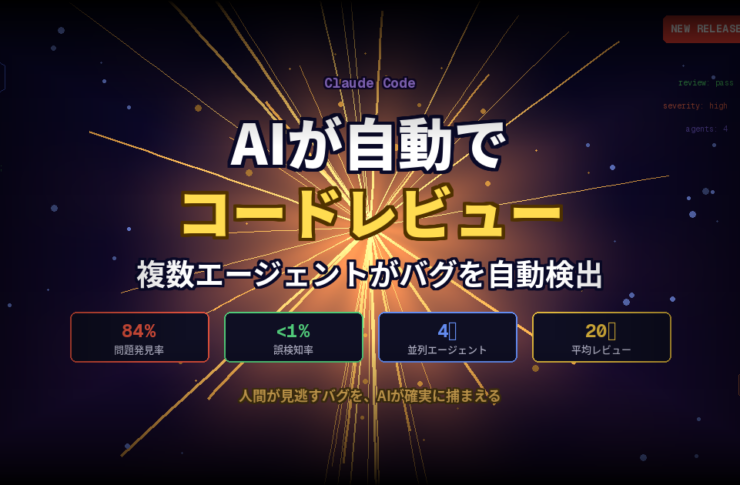

AnthropicがClaude Codeの新機能「Code Review」をリサーチプレビューとして公開しました。

プルリクエスト(PR)を開くだけで、複数のAIエージェントが並列でコードを分析し、バグの検出・検証・深刻度ランキング・インラインコメントの投稿までを自動で行います。

Anthropic社内での運用実績では、レビューコメントがつくPRの割合が16%から54%に急上昇。

大規模PRでの問題発見率は84%に達し、誤検知率は1%未満。

X上では「ゲームチェンジャー」「人間が見逃すバグを確実に拾う」と開発者から絶賛の声が相次いでいます。

何が起きたか

Code Reviewは、Claude CodeのTeamおよびEnterpriseプラン向けに提供される、マネージド型のPRレビューサービスです。

管理者がGitHub Appをインストールしてリポジトリを有効化するだけで、以降はPRが作成されるたびに自動でレビューが走ります。

開発者側の追加設定は不要です。

従来のコードレビューツールとの決定的な違いは、「マルチエージェント」アーキテクチャにあります。PRが開かれると、複数の専門エージェントが並列で異なる観点からコードを分析します。

あるエージェントはロジックエラーを、別のエージェントはセキュリティ脆弱性を、さらに別のエージェントはエッジケースの破綻を探す──という具合に、それぞれが独立して調査を行います。

発見された問題は、次の検証ステップで実際のコード動作と照合され、誤検知がフィルタリングされます。

残った問題は深刻度でランク付けされ、PR上にサマリーコメントとインラインコメントとして投稿されます。

各指摘には「なぜこれを問題と判断したか」の推論過程が折りたたみで付属しており、開発者が根拠を確認できます。

重要な設計原則として、Code ReviewはPRを承認もブロックもしません。

既存のレビューワークフローに「追加の目」として加わる形であり、最終的な判断は人間の開発者に委ねられます。

数字で見る実力

Anthropicは社内で数ヶ月間Code Reviewを運用しており、その実績データを公開しています。

まず、レビューコメントがつくPRの割合が導入前の16%から54%に跳ね上がりました。

つまり、以前は見過ごされていたPRの多くで、実質的な問題が発見されるようになったということです。

1,000行以上の大規模PRでは84%のケースで問題が検出され、平均して1件のPRあたり7.5件の指摘がありました。

一方、50行未満の小規模な変更では31%が指摘対象となっており、変更の規模に応じてエージェントの深さが動的にスケールする設計が効いています。

そして最も注目すべきは、エンジニアが「不正確」とマークした指摘が1%未満だったという誤検知率の低さです。

従来の静的解析ツールでは大量の誤検知に悩まされることが常でしたが、マルチエージェントによる相互検証とコンテキスト理解により、この問題を大幅に軽減しています。

なぜこの機能が重要なのか

コードレビューが”ボトルネック”になっていた

AIによるコード生成が加速する中、開発の生産性は飛躍的に向上しました。

しかし、その裏で深刻化しているのが「レビューのボトルネック」です。

コードが高速に生成される分、PRが積み上がり、レビュアーのリソースが逼迫する。

結果として、多くのPRが「流し読み」で通過し、バグが本番環境に漏れ出す──この悪循環が業界全体の課題となっていました。

Code Reviewは、この構造的な問題に対する直接的な解答です。

「AIが書いたコードをAIがレビューする」というサイクルが成立することで、開発のスピードとコードの品質を両立できる可能性が開けました。

「スタイル警察」ではなく「ロジック理解」

既存のコードレビューツールの多くは、フォーマット違反やネーミング規約のチェックといった「スタイル」レベルの指摘が中心でした。

Code Reviewが根本的に異なるのは、変更されたファイルだけでなく周辺コードやリポジトリ全体の文脈を理解した上で、ロジックレベルの問題を検出する点です。

さらに、リポジトリに「CLAUDE.md」や「REVIEW.md」というファイルを置くことで、「このプロジェクトではどんな問題を重視し、何を無視すべきか」をカスタマイズできます。

たとえば「認可の回帰テストを最優先」「フォーマットの指摘は不要」といった指示が可能で、チームの文脈に合った精密なレビューが実現します。

Anthropicの”歴史的な1日”に登場

Code Reviewのリリースは、Anthropicにとって極めて象徴的なタイミングで行われました。

同日、MicrosoftがClaude技術ベースのCopilot Coworkを発表し、さらにAnthropicがPentagonのブラックリスト指定に対する訴訟を提起。

「製品リリース・巨大パートナーシップ・法的闘争」が同時に進行するという、同社の歴史の中でも最も密度の高い1日となりました。

この文脈で見ると、Code Reviewは単なる新機能ではなく、「Claude Codeをソフトウェア開発のエンドツーエンドプラットフォームにする」というAnthropicの戦略の重要なピースです。

コード生成、セキュリティ(Codex Securityに対抗するClaude Code Security)、そしてコードレビュー──開発ライフサイクルのすべてをカバーする体制が整いつつあります。

住民税の申告は、通常は各市町村の役所で行うことができますので、忘れずに手続きを行いましょう。

誰が、いくらで使えるのか

Code Reviewは現在、Claude CodeのTeamおよびEnterpriseプランでリサーチプレビューとして利用可能です。

レビューはトークン使用量に基づいて課金され、1回あたり平均15〜25ドル程度。

PRの規模と複雑さに応じてコストが変動します。

管理者は月次の支出上限を設定でき、リポジトリごとの有効化/無効化、プッシュごとのレビュー実行か初回のみかの選択も可能です。

利用状況は分析ダッシュボードで確認できます。

なお、セルフホスト環境で動かしたい場合や、PR作成前にローカルでレビューを実行したい場合には、オープンソースのClaude Code GitHub Actionやプラグインマーケットプレイスのcode-reviewプラグインも引き続き利用可能です。

今後の注目ポイント

AIコーディングツールの競争は「コードを書く」フェーズから「コードの品質を保証する」フェーズへと急速にシフトしています。

OpenAIのCodex Securityが脆弱性検出に特化する一方、Claude Code Reviewはロジックエラーや回帰バグまでカバーするより広範なレビューを志向しており、両者のアプローチの違いが今後の競争軸になりそうです。

1回15〜25ドルというコストは決して安くありませんが、「本番環境でのバグ修正にかかるコスト」と比較すれば、安い投資と言えるでしょう。

AIが書いてAIがレビューする──ソフトウェア開発の形が、また一段と変わり始めています。

生成AIに関する記事はこちら!

で

で